警惕数字阴影:Telegram人肉搜索机器人的风险与反思

在即时通讯软件Telegram的庞大生态中,存在着形形色色的机器人(Bot),它们提供从新闻推送到文件管理的各种便捷服务。然而,其中一类被称为“人肉搜索机器人”的工具,正悄然滋生,成为网络空间中的一股暗流。这类机器人通常声称能够通过电话号码、用户名等有限信息,聚合公开或非公开的个人数据,其存在不仅触及法律与道德的灰色地带,更对个人隐私与社会安全构成了严峻挑战。

从技术层面看,这类机器人往往通过爬取互联网上零散分布的公开数据,或利用过往数据泄露的“社工库”信息进行整合。用户只需向机器人发送一个查询请求,如电话号码,它便可能返回关联的社交媒体账号、疑似姓名、甚至地理位置历史等。其危险之处在于,它将原本需要一定技术门槛的信息搜集过程简化为几步简单的对话操作,极大地降低了实施“人肉搜索”的门槛,使得隐私侵犯行为可能被轻易触发。

这种便利性背后隐藏着巨大的危害。首先,它是对个人隐私权的直接践踏。每个人的生活都应保有合理的私密空间,而这类工具将个体信息粗暴地暴露于潜在的网络暴力、骚扰甚至线下安全威胁之下。其次,它极易被用于恶意目的,如网络诈骗、精准勒索、打击报复或商业间谍活动,成为不法分子的“利器”。更深远的影响是,它加剧了社会信任危机,人人可能成为被窥视的对象,从而抑制人们在网络上的自由表达与正常社交。

面对这一问题,法律与平台监管正面临考验。许多国家和地区的数据保护法律(如欧盟的GDPR)明确禁止未经同意收集、处理个人信息。Telegram官方政策也禁止侵犯用户隐私的机器人。然而,匿名性和跨境运营使得追踪和封禁此类机器人存在实际困难。这要求平台方投入更先进的监测技术,加强审核,并与执法机构开展更有效的国际合作。

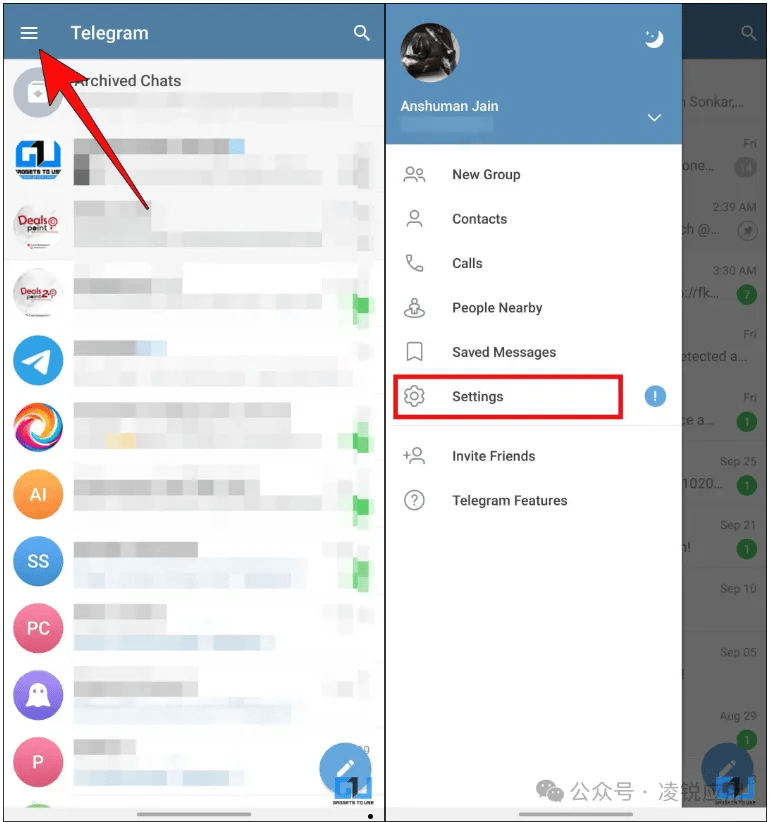

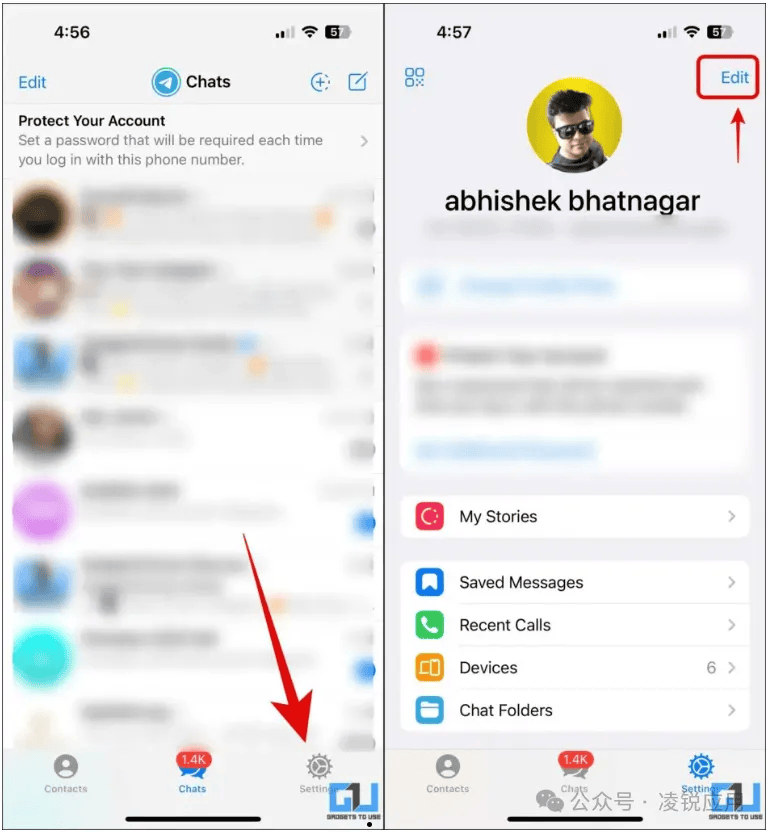

作为普通用户,提高自我保护意识至关重要。应谨慎在公开网络空间分享个人信息,为不同平台设置复杂且独立的密码,并启用双重验证。若发现自己的信息被此类机器人泄露,应立即向平台举报,并在必要时寻求法律帮助。我们需共同认识到,数字时代的隐私并非理所当然,它需要技术设计、法律规范和公民意识的共同守护。

归根结底,Telegram上的“人肉搜索机器人”现象是一面镜子,映照出技术进步与伦理规范之间的持续张力。在享受数字便利的同时,我们必须不断追问:技术的边界在哪里?一个健康的社会,绝不能允许技术沦为窥私与伤害的工具。维护网络空间的清朗与安全,需要各方共同努力,在创新与保护之间找到平衡点,确保科技发展始终服务于人的尊严与福祉。